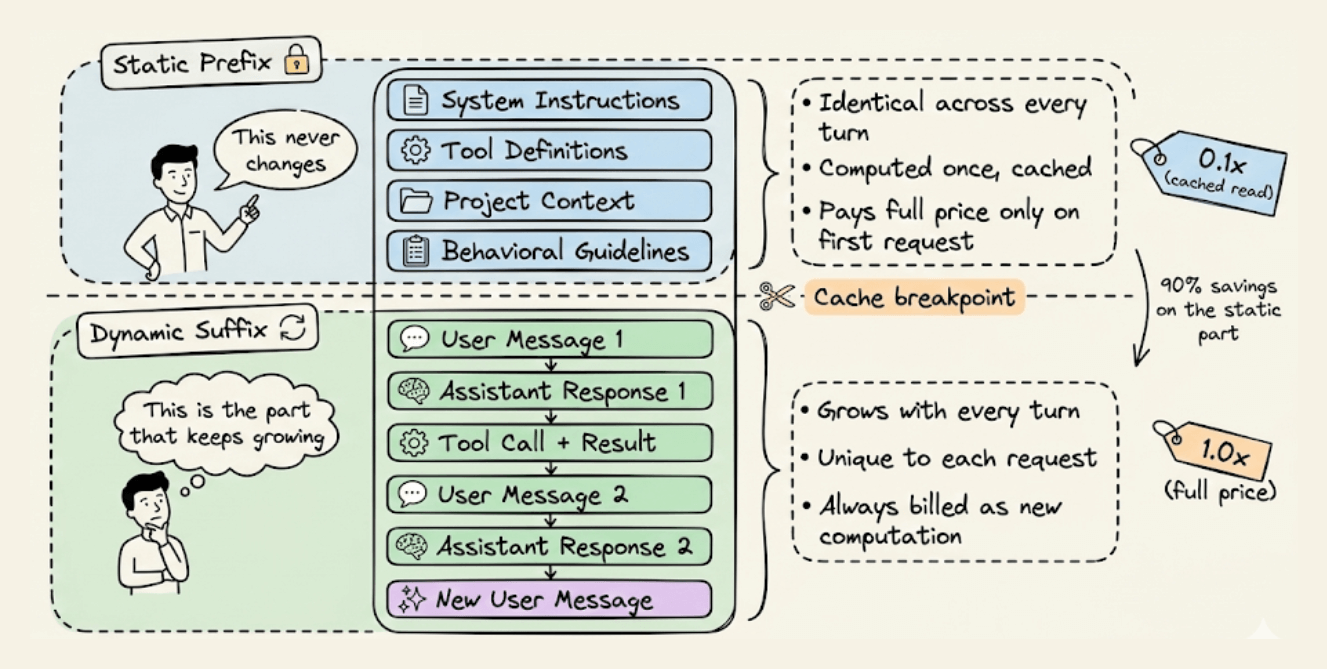

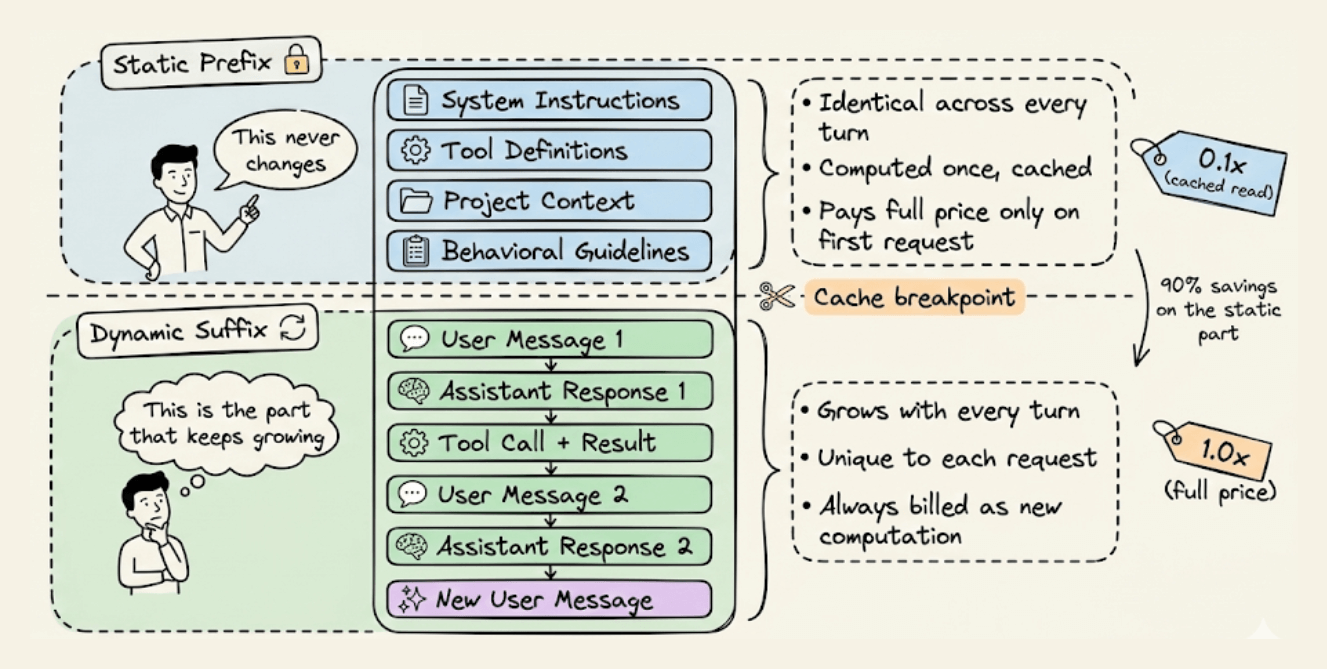

Prompt Caching in LLMs!

A case study on how Claude achieves 92% cache hit-rate.

Soutenez Daily Dose of Data Science en consultant la ressource originale

Lire l'article original

A case study on how Claude achieves 92% cache hit-rate.

Soutenez Daily Dose of Data Science en consultant la ressource originale

Lire l'article originalCombien coûte vraiment un million de tokens quand on ne paie plus l’API, mais l’infrastructure qui les produit ? En partant du prefill, du decode, du batching, du KV cache et des modèles MoE, on estime combien de tokens une infrastructure GPU peut générer.

Anthropic sort un post-mortem sur Claude Code, Google normalise le design system pour l’IA, Zed passe aux agents parallèles et bien plus : ce qu’il ne fallait pas rater cette semaine.

L’IA s’invite dans nos équipes : catalyseur ou perturbateur ? Entre gains de productivité, évolution des rôles et dépendance, cet article décrypte 13 interviews menées chez OCTO. Découvrez les impacts sur l'autonomie, les défis éthiques et la santé mentale pour bâtir une stratégie d'adoption durable et centrée sur l'humain.

Le 22 avril 2026, entre 17h57 et 19h30 (heure de l'Est) — soit une fenêtre d'un peu plus d'une heure et demie — une version piégée du paquet npm @bitwarden/cli@2026.4.0 a été distribuée sur le…